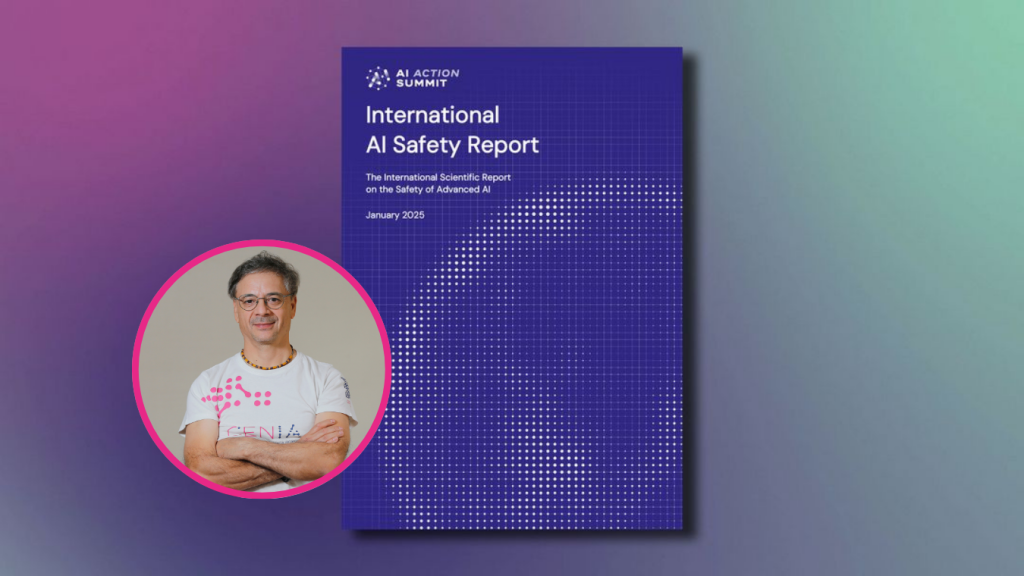

Álvaro Soto, director del Centro Nacional de IA, formó parte de la construcción del recientemente publicado International AI Safety Report, un informe escrito por 100 expertos en IA de 33 países, que contiene una revisión exhaustiva de los riesgos y alcances de los sistemas avanzados de IA. El documento será presentado en la “Cumbre de Acción sobre IA” de París, el próximo 10 y 11 de febrero de 2025.

El 29 de enero de 2025 se publicó el Informe Internacional sobre la Seguridad de la IA (International AI Safety Report 2025), el prestigioso documento dirigido por el científico informático ganador del premio Turing, Yoshua Bengio, y asesorado por un grupo de especialistas de alto nivel, que entrega un detallado análisis sobre los alcances y los riesgos de los modelos más avanzados de Inteligencia Artificial (IA).

Este documento, que cuenta con el apoyo del Ministerio de Ciencia, Innovación y Tecnología del Reino Unido, fue elaborado por un grupo multidisciplinario de 100 expertos en IA, varios de ellos nominados por representantes de 33 países y de organizaciones intergubernamentales como las Naciones Unidas, la Unión Europea y la OCDE.

En el marco de este proyecto internacional, el director del CENIA, Dr. Álvaro Soto, participó como Senior Advisor de la Comisión Consultiva de Expertos, colaborando específicamente en dos capítulos del informe: uno referido al avance técnico de la IA y otro centrado en las implicancias prácticas de estos desarrollos. “El informe equilibra la profundidad y rigurosidad científica a través de un lenguaje que también resulta accesible para públicos no especializados. Además, incorpora referencias recientes que pueden guiar a investigadores y profesionales a profundizar en las tendencias más emergentes de la IA”, señala.

“Este era uno de los desafíos, y creo que el documento lo logró bastante bien. Es difícil a veces llegar a las personas que no saben tanto de IA, y al mismo tiempo a las que saben mucho de IA. Eso es algo que en nuestros capítulos le pusimos harto empeño. (…) En el informe usamos referencias que son bien recientes, y explicamos por qué son importantes, y cómo eso puede ayudar a transformar en los próximos años y en el futuro inmediato lo que está sucediendo con la IA. Para alguien que se dedica a la Inteligencia Artificial, esto incluso puede ser un aporte, porque habla de avances que quizás aún no sabe o que son muy recientes.”

Sobre el informe

El International AI Safety Report 2025 es el resultado del acuerdo alcanzado por 30 países durante la Cumbre de Seguridad de la IA de Bletchley, que buscaban crear una visión científica compartida sobre los riesgos y las capacidades de los modelos avanzados de IA. El documento no formula recomendaciones políticas, sino que sintetiza evidencia científica para guiar la discusión internacional en torno a la seguridad de la IA de propósito general. Entre sus principales objetivos se incluyen:

- Proporcionar información científica confiable que respalde la formulación de políticas informadas.

- Facilitar un debate constructivo y basado en evidencia sobre la ince rtidumbre que rodea a la IA de propósito general.

- Contribuir a una comprensión compartida a nivel global de la seguridad de la IA avanzada.

Entre los temas abordados en el informe se encuentran las potenciales transformaciones en el mercado laboral, los riesgos medioambientales asociados a la creciente demanda de energía para la implementación de modelos de IA, la preocupación por el desarrollo de agentes autónomos y la vulnerabilidad en ciberseguridad. Asimismo, se analiza el impacto de las tecnologías de IA en la generación de deepfakes, destacando la necesidad de una mayor transparencia y colaboración para enfrentar los usos maliciosos de la Inteligencia Artificial.

El informe se presentará oficialmente durante la Cumbre de Acción sobre IA, que tendrá lugar en París el próximo 10 y 11 de febrero, y es parte de una iniciativa a largo plazo para profundizar en la comprensión internacional de los riesgos de la IA.

Por: Gianyser González